Mirage 2: Generative Spielwelten – neue Angriffsflächen für IT-Security

Lesezeit: 6 Min.

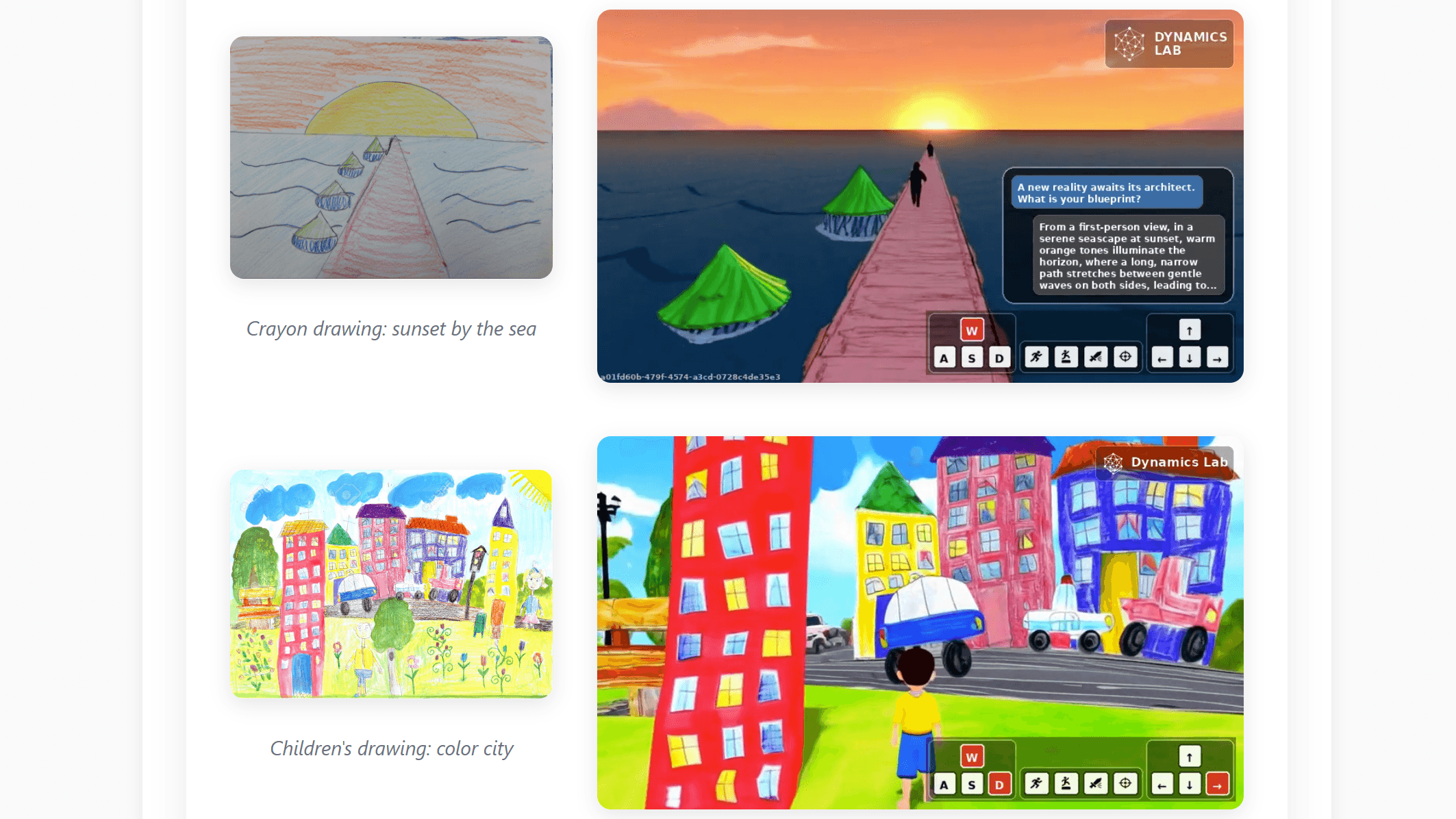

Dynamics Lab hat Mirage 2 vorgestellt – eine Engine, die aus Skizzen und Fotos interaktive Spielwelten erzeugt. Das ist ein kreativer Meilenstein für Entwickler und Creator. Gleichzeitig entstehen neue Risiken: KI-generierte Inhalte, automatisierte Pipelines und Community-Features erweitern die Angriffsfläche. Wenn Du in IT-Sicherheit arbeitest, solltest Du diese Entwicklung jetzt strategisch einordnen.

Was hinter Mirage 2 steckt – und warum Security von Anfang an mitdenken sollte

Mirage 2 ist eine generative Game-World-Engine: Aus einfachen Skizzen oder Fotos können in kurzer Zeit interaktive Szenen entstehen. Für Studios, Modder und Marken eröffnet das neue Content-Geschwindigkeiten und Prototyping-Möglichkeiten. Doch je mehr sich Content-Erzeugung automatisiert, desto wichtiger wird es, Sicherheit als Teil des Entwicklungsprozesses zu verankern – vom ersten Asset bis zum Live-Betrieb.

Gerade bei User-Generated Content (UGC) und KI-gestützten Workflows gilt: Wo Daten importiert, umgewandelt und verteilt werden, lauern potenzielle Schwachstellen. Begriffe wie Supply-Chain-Security, Zero-Day und Security Awareness sollten darum auch in Game- und Immersive-Tech-Teams fest verankert sein.

Branchenreports zeigen, dass ein großer Teil erfolgreicher Ransomware-Angriffe mit Phishing beginnt – oft über scheinbar legitime Projektdateien oder Kollaborations-Invites. Gerade kreative Teams sind ein beliebtes Ziel.

Neue Angriffsflächen durch generative Engines

User-Generated Content als Einfallstor

Wenn aus Skizzen und Fotos automatisiert Welten entstehen, steigen Upload- und Importvolumina. Schädliche Assets können versuchen, Parser-Schwächen auszunutzen oder Manipulationen an Metadaten zu platzieren. Für IT-Security bedeutet das:

- Asset-Sandboxing: Jeder Import läuft in einer isolierten Umgebung. Signaturen, Heuristiken und Verhaltensanalysen prüfen Dateien vor der Freigabe in die Produktionspipeline.

- Validierung & Normalisierung: Strikte Prüfungen für Bild-, 3D- und Script-Formate reduzieren das Risiko von Deserialisierungsfehlern – ein typischer Weg für Zero-Day-Exploits.

- Content-Governance: Klare Regeln, wer was importieren darf. Ergänze dies durch Security-Awareness-Trainings speziell für Art- und Level-Design-Teams.

Plugins, Skripte und Sandboxing

Generative Engines leben von Erweiterungen. Doch jedes Plugin ist potenziell Teil der Software-Supply-Chain. Unsichere Abhängigkeiten, kompromittierte Repositories oder typosquatting-Pakete sind reale Gefahren.

- SBOM & Signaturen: Halte eine Software Bill of Materials (SBOM) aktuell. Verlange signierte Releases und prüfe Hashes in der CI/CD.

- Least Privilege: Plugins laufen mit minimalen Rechten und in getrennten Sandboxes. Netzwerkzugriffe nur, wenn nötig, und per Allowlist.

- Dependency Pinning: Fixiere Versionen, nutze private Registries und setze Policy as Code für kritische Pakete.

Datenschutz, IP-Leaks und Modell-Missbrauch

Fotos sind oft personenbezogen oder rechtlich geschützt. Werden sie in generativen Prozessen verarbeitet, drohen Privacy– und Compliance-Risiken. Zudem ist der Schutz Deiner Prompts und generativen Modelle wichtig, um Missbrauch und geistige Eigentumsverletzungen zu verhindern.

- Data Governance: Klassifiziere Eingaben, nutze Pseudonymisierung und halte Löschkonzepte vor.

- Zugriffskontrolle: SSO/MFA, Rollenmodelle und Protokollierung. Prüfe regelmäßig Berechtigungen.

- Modell- und Prompt-Sicherheit: Verhindere Prompt-Injektionen in Toolchains, trenne Trainings- und Produktionsdaten strikt.

Bedrohungslage: Von Phishing bis Ransomware in kreativen Teams

Kreativ- und Dev-Teams sind kollaborativ, teilen Dateien und arbeiten unter Termindruck – ideale Bedingungen für Social Engineering. Angriffe tarnen sich als „Referenzfotos“, „Shader-Update“ oder „Szenen-Paket“.

- Phishing: Gefälschte Einladung zu Asset-Ordnern, mit Keyloggern in vermeintlichen Tools. Übe regelmäßig mit Phishing-Simulationen.

- Ransomware: Build-Server, Asset-Stores und Versionierungssysteme sind attraktive Ziele. Segmentiere Netze, isoliere Build-Agents und sichere Backups offline.

- Impersonation & Deepfakes: KI-Assets können Marken und Personen täuschend echt nachstellen. Richte Prozesse zur schnellen Takedown-Anfrage und Beweissicherung ein.

Wer Mirage 2 oder ähnliche Tools einsetzt, sollte die Zero-Day-Trends verfolgen und ein Red-Teaming einplanen, das die spezifischen Workflows für generative Inhalte imitiert.

Praktische Sicherheitsmaßnahmen für Studios und Unternehmen

Mit den folgenden Maßnahmen erhöhst Du die Resilienz Deiner Mirage-2-Workflows – ohne die kreative Geschwindigkeit auszubremsen:

- Threat Modeling für Content-Pipelines: Identifiziere Angriffswege vom Asset-Upload bis zur Veröffentlichung. Dokumentiere Gegenmaßnahmen als wiederverwendbare Controls.

- Isolierte Build- und Render-Umgebungen: Containerisiere Jobs, setze Kurzzeit-Credentials und scanne Artefakte vor der Verteilung.

- EDR/XDR auf Workstations und Build-Agents: Erkenne Anomalien in Echtzeit, korreliere Telemetrie aus Editor, Plugins und Netzwerkzugriffen.

- Code Signing & Release-Gates: Jede ausführbare Komponente – inklusive Plugins – wird signiert. Releases passieren nur nach automatisierten Security-Gates.

- Backup- und Restore-Drills: Teste Wiederherstellungen unter Zeitdruck. Nutze Immutable-Backups und versionierte Asset-Stores.

- Security Awareness: Rolle zielgruppenspezifische Trainings für Artists, Level-Designer und Tool-Programmierer aus. Ergänze dies durch kurze Micro-Learnings im Editor-Kontext.

- Vulnerability Disclosure Program: Stelle einen klaren Meldeweg bereit, um Schwachstellen in Pipelines, Plugins oder Projekten verantwortungsvoll aufzunehmen.

Pro und Contra: Generative Engines im Produktionsbetrieb

- Schnelleres Prototyping und Content-Skalierung

- Geringere Einstiegshürden für kleine Teams

- Neue kreative Formate und Interaktionen

- Erweiterte Angriffsfläche durch UGC und Plugins

- Höherer Aufwand für Governance & Compliance

- Abhängigkeit von Modell- und Tool-Supply-Chain

Mini-Fallstudie (fiktiv): Sichere Einführung von Mirage 2

Ein mittelgroßes Studio möchte Mirage 2 für schnelle Level-Skizzen nutzen. Vor dem Rollout wird eine dedizierte „GenArt“-Pipeline aufgebaut: Uploads laufen in eine Quarantäne, ein Asset-Scanner prüft Metadaten und Dateistrukturen, die Generierung erfolgt in Containern ohne Internetzugriff. Plugins werden aus einer internen, signierten Registry bezogen. Das Team führt verpflichtende Awareness-Trainings durch und testet regelmäßig mit Phishing-Simulationen. Ergebnis: kürzere Prototyping-Zeiten bei gleichbleibend niedrigem Risiko – und klaren Playbooks für Incident Response.

Fazit: Kreativität pushen, Risiken beherrschen

Mirage 2 zeigt, wie rasant KI die Content-Erstellung verändert. Für IT-Sicherheit heißt das: Geschwindigkeit ja – aber mit Guardrails. Wer UGC, Plugins und automatisierte Pipelines absichert, senkt das Risiko für Phishing, Ransomware und Zero-Day-Exploits deutlich. Baue jetzt Security-by-Design in Deine kreativen Workflows ein und verankere kontinuierliche Schulungen. Starte mit einem Threat-Model, etabliere SBOM und Signaturen und teste regelmäßig Deine Notfallpläne.

Mehr Impulse findest Du in unseren Leitfäden zu SBOM & Software-Supply-Chain sowie im aktuellen Beitrag zu Zero-Day-Trends. Wenn Du Unterstützung für Red Teaming oder sichere CI/CD-Pipelines brauchst, sprich uns an.

Tags: KI-Sicherheit, Game-Development, Supply-Chain-Security, Phishing, Zero-Day